Muitos programadores olham para a inteligência artificial com desconfiança. Alguns criticam abertamente. Outros tratam como moda passageira. Mas a maioria que critica comete um erro fundamental: não entende como a tecnologia realmente funciona por dentro.

A verdade é que a IA generativa que hoje escreve código, gera textos e responde perguntas complexas opera com um mecanismo surpreendentemente simples na sua essência. É um autocomplete. Sofisticado, treinado com quantidades absurdas de dados, operando com trilhões de parâmetros, mas no fundo, um autocomplete. E entender isso muda completamente a forma como você usa (ou deveria usar) essa tecnologia no seu dia a dia como desenvolvedor.

O Autocomplete do Seu Celular Já Explica Tudo

Pense no teclado do seu smartphone. Quando você digita “bom”, ele sugere “dia”. Quando escreve “obrigado pela”, ele provavelmente sugere “ajuda” ou “atenção”. Esse autocomplete aprende com o seu histórico de digitação, com os padrões de linguagem mais comuns e com o contexto imediato da frase.

A IA generativa faz exatamente a mesma coisa. A diferença não está no conceito, está na escala. Enquanto o autocomplete do celular opera com milhares de parâmetros e um vocabulário limitado, um LLM (Large Language Model) como o GPT-4 ou o Claude opera com centenas de bilhões de parâmetros, treinados em trilhões de tokens de texto extraídos da internet, livros, artigos científicos e código-fonte.

Segundo a CogitoAI, “LLMs funcionam prevendo qual é a próxima palavra mais provável em uma sequência de texto. Com bilhões de parâmetros, o resultado é surpreendentemente inteligente.” É matemática probabilística em escala industrial.

Next Token Prediction: A Engrenagem Por Trás de Tudo

O termo técnico para o que a IA faz é “next token prediction”, ou previsão do próximo token. Um token pode ser uma palavra inteira, parte de uma palavra ou até um caractere, dependendo do modelo. O processo funciona assim: o modelo recebe uma sequência de tokens e calcula a probabilidade de cada token possível ser o próximo na sequência.

A arquitetura que tornou isso viável foi o Transformer, apresentado por Vaswani e outros pesquisadores em 2017 no paper “Attention is All You Need”. Essa arquitetura introduziu o mecanismo de atenção, que permite ao modelo ponderar a importância de cada palavra anterior ao prever a próxima. Como explica o blog da Futago AI, essa inovação “revolucionou o campo da inteligência artificial ao permitir o processamento eficiente de grandes sequências de texto.”

Na prática, quando você pede para uma IA “escreva uma função que ordena uma lista em Python”, o modelo não “entende” o que é ordenação. Ele calcula, token por token, qual é a sequência mais provável de caracteres que viria depois desse prompt, baseado em milhões de exemplos de código Python que viu durante o treinamento.

Por Que Parece Inteligente Se É “Só” Estatística

Essa é a pergunta que incomoda muita gente. Se a IA é apenas um autocomplete glorificado, por que ela consegue resolver problemas complexos de programação, escrever textos coerentes e até passar em exames médicos?

A resposta está na escala e na emergência. Quando você treina um modelo com centenas de bilhões de parâmetros em trilhões de exemplos, comportamentos surpreendentes emergem. O modelo desenvolve a capacidade de fazer analogias, seguir instruções multi-passo e adaptar respostas ao contexto, não porque foi programado para isso, mas porque esses padrões estão implícitos nos dados de treinamento.

É como a diferença entre uma calculadora de bolso e um supercomputador. Ambos fazem contas. Mas a escala muda qualitativamente o que é possível resolver. O autocomplete do celular sugere a próxima palavra. O GPT-4 sugere os próximos 10 mil tokens de um artigo técnico coerente. A operação base é a mesma. O resultado é radicalmente diferente.

O Impacto Real na Vida do Programador em 2026

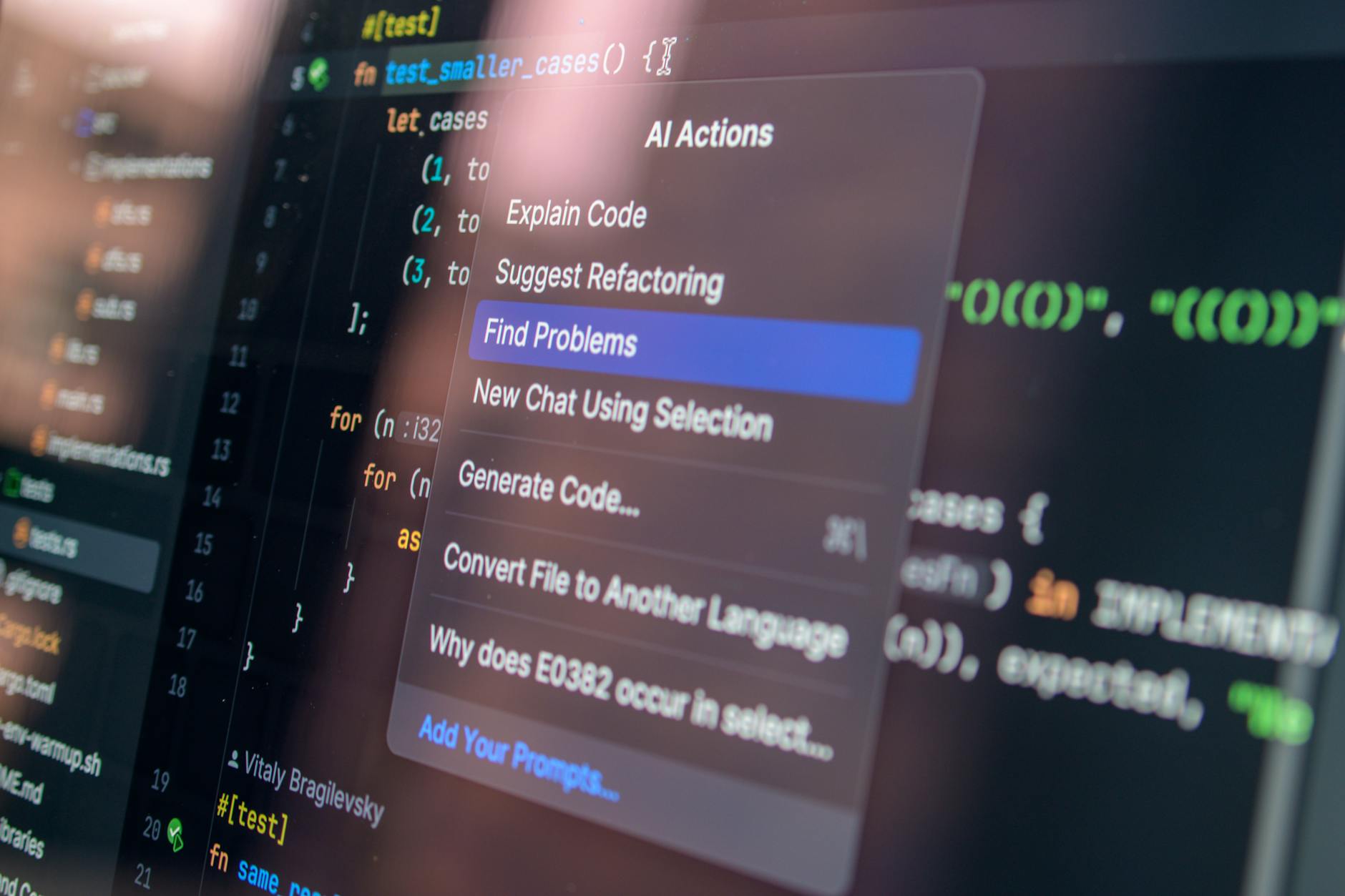

Segundo o MIT Technology Review, ferramentas de IA para código surgiram por volta de 2016 como autocomplete simples, sugerindo o que digitar a seguir. Hoje, em 2026, essas ferramentas analisam codebases inteiros, editam múltiplos arquivos simultaneamente, corrigem bugs e geram documentação completa.

Mas os ganhos reais são mais modestos do que o hype prometeu. Dados de pesquisas recentes mostram que assistentes de IA entregam ganhos de produtividade entre 20% e 30% em workflows específicos, não os 10x que foram prometidos em 2023. Um dado interessante: desenvolvedores júniors obtêm ganhos massivos com essas ferramentas, enquanto desenvolvedores seniores veem melhorias marginais.

Isso faz sentido quando você entende o mecanismo. A IA é excepcional para tarefas onde padrões são previsíveis: boilerplate, CRUD, testes unitários repetitivos, documentação padrão. Ela trava quando precisa lidar com lógica de negócio complexa, edge cases incomuns ou decisões arquiteturais que exigem contexto que não está no código.

As Limitações que Todo Programador Precisa Conhecer

Entender que a IA é um autocomplete não é diminuir a tecnologia. É calibrar expectativas corretamente. LLMs são previsores probabilísticos de tokens. Isso significa que eles podem:

- Gerar código que parece correto mas falha em edge cases

- Produzir loops infinitos ou erros de stack overflow em lógica de terminação

- Alucinar funções, APIs ou bibliotecas que não existem

- Repetir padrões comuns mesmo quando a situação exige uma solução não convencional

A IA automatizou o que podemos chamar de “programação como digitação”. O que ela não automatizou, e provavelmente não vai automatizar tão cedo, é o raciocínio que vai da definição do problema até o impacto real: scoping, restrições, ética, qualidade dos dados e operações em produção.

O Futuro: Além do Next Token Prediction

O mercado está evoluindo rapidamente. Em 2026, a IA agêntica comanda 55% da atenção do setor de tecnologia, com sistemas autônomos que planejam, executam, testam e iteram com mínima intervenção humana. O Gartner prevê que 40% das aplicações empresariais terão agentes de IA embutidos até o final do ano.

Isso não invalida o mecanismo base de previsão de token. Na verdade, os agentes de IA são construídos sobre essa fundação, combinando múltiplas chamadas de LLM com ferramentas externas, memória e loops de raciocínio. O autocomplete não morreu. Ele ganhou braços, pernas e autonomia.

Para programadores, a mensagem é clara: pare de criticar o que você não entende e comece a estudar como a tecnologia funciona por dentro. A IA não é sua inimiga. É uma ferramenta poderosa que, quando usada com compreensão do seu mecanismo, pode transformar a forma como você desenvolve software. E tudo começa entendendo que, no fundo, é um autocomplete que ficou absurdamente bom.

Este artigo foi baseado no vídeo “IA Explicada: Autocomplete Avançado para Programadores” do canal de Thulio Bittencourt no YouTube.